רק תשע חברות טכנולוגיה ענקיות בארה'ב ובסין עומדות מאחורי הרוב המכריע של ההתקדמות בתחום הבינה המלאכותית ברחבי העולם. בספרה החדש, התשע הגדולות: כיצד הטיטאנים הטכניים ומכונות החשיבה שלהם עלולים לעוות את האנושות (PublicAffairs, 5 במרץ), איימי ווב צופה שלושה עתידיים אפשריים, נעים בין אופטימי לאפוקליפטי, שיכולים לנבוע מהפעולות שאנו מבצעים - או לא מבצעים - בכדי לשלוט בהתפתחות A.I. ולעצב את השפעתו העולמית. בקטע זה היא מעלה סדרה של שאלות אתיות קשות שבני האדם בונים A.I. על מערכות להשתמש בהן כדי להנחות את עבודתן.

הכללים - האלגוריתם - שלפיו כל תרבות, חברה ואומה חיו, וחיו אי פעם, נוצרו תמיד על ידי אנשים מעטים בלבד. דמוקרטיה, קומוניזם, סוציאליזם, דת, טבעונות, נאטיביזם, קולוניאליזם - אלה קונסטרוקציות שפיתחנו במהלך ההיסטוריה כדי להנחות את החלטותינו. גם במקרים הטובים ביותר, הם אינם עמידים בפני העתיד. כוחות טכנולוגיים, חברתיים וכלכליים תמיד מתערבים וגורמים לנו להסתגל.

עשרת הדיברות מהווים אלגוריתם שנועד ליצור חברה טובה יותר לבני אדם לפני למעלה מ -5,000 שנה. אחת המצוות היא לקחת יום מנוחה שלם בשבוע ולא לעשות שום עבודה כלל באותו יום. בעידן המודרני, רוב האנשים לא עובדים באותם ימים או שעות בדיוק משבוע לשבוע, כך שאי אפשר יהיה שלא להפר את הכלל. כתוצאה מכך, אנשים שעוקבים אחר עשרת הדיברות כעיקרון מנחה הם גמישים בפרשנותם, לאור המציאות של ימי עבודה ארוכים יותר, אימון כדורגל ודואר אלקטרוני. ההסתגלות היא בסדר - זה עובד ממש טוב עבורנו, ועבור החברות שלנו, ומאפשר לנו להישאר על המסלול. הסכמה למערך בסיסי של הנחיות מאפשרת לנו לבצע אופטימיזציה לעצמנו.

למי נשוי טריש סטרטוס

לא תהיה שום דרך ליצור סט מצוות עבור A.I. לא יכולנו לכתוב את כל הכללים כדי לבצע אופטימיזציה נכונה לאנושות, וזה מכיוון שאמנם מכונות חשיבה עשויות להיות מהירות וחזקות, אך הן חסרות גמישות. אין דרך קלה לדמות חריגים, או לנסות לחשוב מראש על כל מצב. לא משנה מה החוקים ייכתבו, תמיד תהיה מצב בעתיד בו אנשים עשויים לרצות לפרש את הכללים אחרת, או להתעלם מהם לחלוטין, או ליצור תיקונים כדי לנהל נסיבות בלתי צפויות.

מתוך ידיעה שאיננו יכולים לכתוב קבוצה של מצוות קפדניות לקיים, האם עלינו למקד את תשומת ליבנו בבני האדם הבונים את המערכות? אנשים אלה - שבטי A.I. צריכים לשאול את עצמם שאלות לא נוחות, החל מ:

כמה שווה לייסי צ'ברט

- מה המניע שלנו ל- A.I.? האם זה מתיישב עם האינטרסים הטובים ביותר של האנושות לטווח הארוך?

- מהן ההטיות שלנו? אילו רעיונות, חוויות וערכים לא הצלחנו לכלול בשבטנו? למי התעלמנו?

- האם צירפנו אנשים שלא כמונו במטרה להפוך את העתיד של A.I. טוב יותר - או שמא פשוט כללנו מגוון בצוות שלנו כדי לעמוד במכסות מסוימות?

- כיצד נוכל להבטיח שהתנהגותנו כוללת?

- איך ההשלכות הטכנולוגיות, הכלכליות והחברתיות של A.I. מובן על ידי המעורבים ביצירתו?

- אילו זכויות בסיסיות עלינו לחקור את מערכי הנתונים, האלגוריתמים והתהליכים המשמשים לקבלת החלטות בשמננו?

- מי זוכה להגדיר את ערך חיי האדם? כנגד מה נשקל הערך הזה?

- מתי ולמה אלו בשבטים של א.י. מרגישים כי באחריותם לטפל בהשלכות החברתיות של א.י.

- האם הנהגת הארגון שלנו ו- A.I. שבטים משקפים סוגים רבים ושונים של אנשים?

- מה התפקיד שעושים אלה המתמחים ב- A.I. לשחק בהתמודדות עם ההשלכות החברתיות של A.I.?

- האם עלינו להמשיך ולהשוות את A.I. לחשיבה אנושית, או שמא עדיף לנו לסווג אותה כמשהו שונה?

- האם זה בסדר לבנות A.I. שמזהה ומגיב לרגש אנושי?

- האם זה בסדר להפוך את A.I. מערכות המסוגלות לחקות את הרגש האנושי, במיוחד אם הוא לומד מאיתנו בזמן אמת?

- מהי הנקודה המקובלת בה כולנו בסדר עם A.I. מתפתח בלי בני אדם ישירות בלולאה?

- באילו נסיבות יכול א.י. לדמות ולחוות רגשות אנושיים משותפים? מה עם כאב, אובדן ובדידות? האם אנו בסדר וגורמים לסבל זה?

- האם אנו מפתחים את A.I. לחפש הבנה עמוקה יותר של עצמנו? האם נוכל להשתמש ב- A.I. לעזור לאנושות לחיות חיים נבחנים יותר?

ישנן תשע חברות טכנולוגיה גדולות - שש אמריקאיות ושלוש סיניות - האחראיות באופן גורף לעתיד הבינה המלאכותית. בארה'ב הם גוגל, מיקרוסופט, אמזון, פייסבוק, יבמ ואפל ('G-MAFIA'). בסין זה ה- BAT: באידו, עליבאבא וטנסנט.

ה- G-MAFIA החל לטפל בבעיה של עקרונות מנחים באמצעות קבוצות מחקר ומחקר שונות. בתוך מיקרוסופט נמצא צוות בשם FATE - למען הוגנות, אחריות, שקיפות ואתיקה ב- A.I. בעקבות שערוריית קיימברידג 'אנליטיקה, פייסבוק השיקה צוות אתיקה שפיתח תוכנה כדי לוודא שה- A.I. מערכות נמנעו מהטיות. (יש לציין שפייסבוק לא הרחיקה לכת ויצרה לוח אתיקה הממוקד ב- A.I) DeepMind יצר צוות אתיקה וחברה. יבמ מפרסמת באופן קבוע אודות אתיקה ו- A.I. בעקבות שערורייה בבאידו - מנוע החיפוש העדיף תביעות רפואיות מטעות מבית חולים המנוהל על ידי צבא, שם הטיפול הביא למותו של סטודנט בן 21 - מנכ'ל ביידו, רובין לי, הודה כי העובדים ביצעו מתפשר למען צמיחת הרווחים של באידו והבטיח להתמקד באתיקה בעתיד.

למי נשוי כריס קריסטופסון

The Big Nine מייצרת מחקרי אתיקה וכתבות לבנות, היא מכנסת מומחים לדיון באתיקה, והיא מארחת פאנלים בנושא אתיקה - אך מאמץ זה אינו שזור מספיק בפעילות השוטפת של הצוותים השונים העובדים ב- A.I.

התשע הגדולה של A.I. מערכות הולכות וגוברות לנתונים שלנו בעולם האמיתי כדי לבנות מוצרים שמראים ערך מסחרי. מחזורי הפיתוח מואצים כדי לעמוד בקצב ציפיות המשקיעים. היינו מוכנים - אם לא רוצים - להשתתף בעתיד שנוצר בחופזה ומבלי לענות קודם על כל השאלות האלה. כפי שא.י. מערכות מתקדמות ויותר מחיי היומיום נעשים אוטומטיים, ככל שיש לנו פחות שליטה על ההחלטות שמתקבלות לגבינו ובשבילנו.

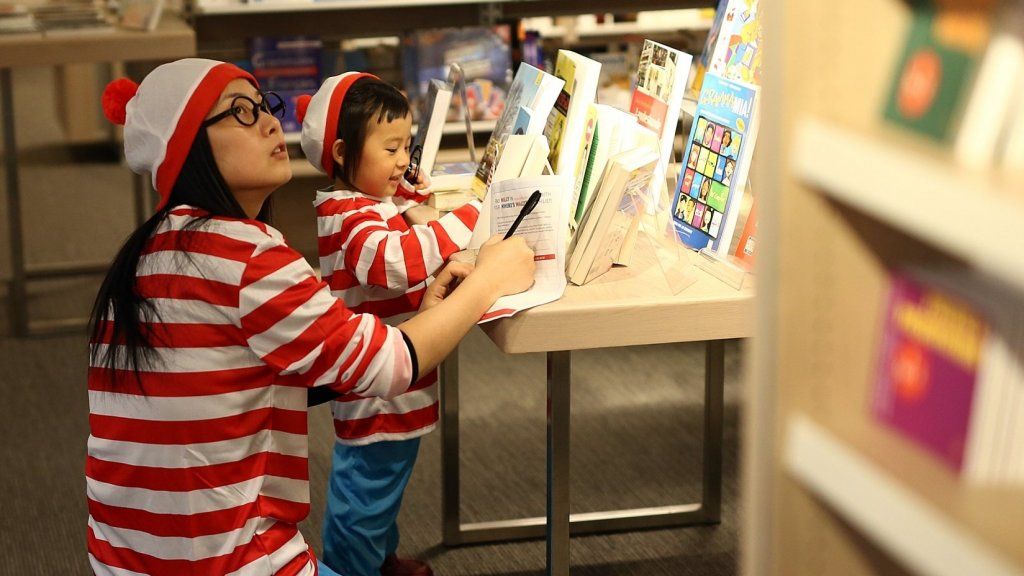

איימי ווב תופיע ב בע'מ בית המייסדים באוסטין ב -11 במרץ.